Компания Google сделала значительный шаг вперед в части ускорения работы систем машинного обучения, создав собственный чип, который она успешно применяет уже больше года.

По слухам, при разработке своего чипа компания активно использовала рекламные объявления о вакансиях, публиковавшиеся в последние годы. Но до последнего времени информация о предпринимавшихся усилиях хранилась в тайне.

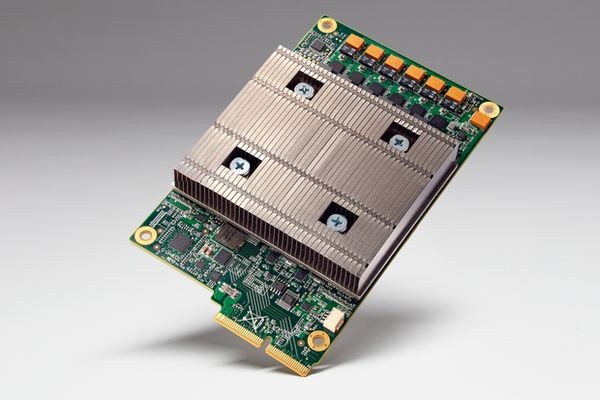

Название Tensor Processing Unit (TPU) чип получил в честь программного обеспечения TensorFlow, применявшегося в системах машинного обучения. В своем блоге инженер Google Норм Юппи называет его акселератором, предназначенным для ускорения решения определенных задач.

На недавней конференции Google I/O генеральный директор Google Сундар Пичаи заявил, что при решении задач машинного обучения TPU обеспечивает на порядок лучшее соотношение между производительностью и энергопотреблением по сравнению с существующими чипами. Он не предназначен для замены центральных или графических процессоров, но способен заметно ускорить процессы машинного обучения без существенного увеличения энергопотребления.

В условиях, когда машинное обучение все шире применяется в приложениях самого разного вида, начиная от распознавания голоса и заканчивая переводом на другие языки и анализом данных, наличие процессора, который значительно ускоряет выполнение соответствующих операций, имеет очень важное значение для поддержания темпов развития на должном уровне.

По мере замедления действия закона Мура и уменьшения преимуществ, получаемых от каждого очередного поколения процессоров, использование аппаратных ускорителей при решении ключевых задач приобретает все более важное значение. В Google утверждают, что появление TPU стало эквивалентом скачка вперед сразу на три процессорных поколения или примерно на семь лет, если исходить из закона Мура.

TPU уже находит применение в облаке Google, в том числе в системе сортировки результатов поиска RankBrain и сервисах распознавания речи. Когда разработчики обращаются к Google Voice Recognition Service, они используют TPU.

Старший вице-президент Google Урс Хельцле заявил, что TPU позволяет поднять процессы машинного обучения на новый качественный уровень, но при этом все равно остаются функции, требующие использования центральных и графических процессоров.

Разработка TPU началась около двух лет тому назад.

Сегодня у Google используется около тысячи подобных чипов. В стойках ЦОД они размещаются в тех же отсеках, что и жесткие диски, поэтому компания легко может развернуть гораздо больше TPU при возникновении такой потребности.

Но сейчас, по словам Хельцле, нет необходимости размещать TPU в каждой стойке.

При этом Google определенно не собирается продавать TPU в качестве отдельного продукта. На вопрос о возможности таких поставок Дайана Грин, возглавляющая подразделение Google, обслуживающее корпоративных клиентов, заявила, что компания не планирует продавать эти чипы другим игрокам ИТ-рынка.

В какой-то степени это обусловлено современными технологическими тенденциями – разработчики размещают все больше и больше приложений в облаке, не желая заниматься управлением, поддержкой и модернизацией аппаратных конфигураций.

Другая причина, вероятно, заключается в том, что Google просто не желает предоставлять конкурентам доступ к своим чипам, на создание которых было потрачено столько времени, денег и идей.

Пока мы не знаем точно, в каких областях TPU проявляют себя лучше всего. Аналитик Патрик Мурхед полагает, что они будут использоваться при выполнении операций логического вывода – составной части машинного обучения, не требующей высокой гибкости.

На сегодняшний день это вся информация, которую нам удалось получить от Google. Мы не знаем, какой производитель поставляет Google готовую продукцию. Более подробные сведения о чипе Хольцле обещает опубликовать в специальном документе, который планируется подготовить к осени текущего года.

.jpg)